Cyabra analiza los rostros para identificar «deepfakes». Foto: Shutterstock

¿Cuándo? Noviembre de 2020, solo unos días antes de las elecciones presidenciales de EEUU.

¿Qué pasa? Se viraliza un video que muestra a uno de los principales candidatos diciendo algo provocativo y fuera de lugar. La gente se indigna y el otro contendiente gana el debate.

¿Algo más? Sí, el video no es auténtico sino un «deepfake” en el que el rostro de una persona se superpone al cuerpo de otra gracias a técnicas de inteligencia artificial sofisticada. Además se agrega una voz a través de herramientas de doblaje de audio inteligente.

Bien, esto es futurología pero es muy posible que hechos como estos se puedan dar para inclinar la balanza de un lado.

¿Cuándo? Septiembre de 2019.

¿Qué pasa? La empresa de inteligencia artificial Deeptrace descubrió 15.000 videos “deepfakes”, el doble de lo que había en línea a principios del año pasado.

Es que hoy, cualquier persona con una computadora relativamente avanzada puede utilizar ciertas tecnologías para promover la desinformación, tanto en política como en otras industrias donde la credibilidad es clave. Ejemplos: bancos, productos farmacéuticos y entretenimiento.

La startup Cyabra de Israel es uno de los pioneros en la veloz identificación de ese tipo de piezas digitales. Gracias a su desarrollo, los videos falsos pueden eliminarse antes de que se viralicen.

El director general de Cyabra, Dan Brahmy, le dijo a ISRAEL21c que existen dos maneras de entrenar a un algoritmo informático para analizar la autenticidad de un video.

«En un enfoque supervisado, le damos al algoritmo un conjunto de datos de, un ejemplo, 100.000 imágenes de caras normales y rostros intercambiados. El 95 por ciento de las veces, el algoritmo puede detectar ese tipo de conmutaciones», explicó el ejecutivo

Además, hay otro sistema: un «enfoque no supervisado» inspirado en la agricultura. «Si vuela un dron sobre un campo de maíz y quiere saber qué cultivo está listo para ser cosechado y cuál no, se analizarán diferentes colores o la forma en que sopla el viento. ¿El maíz gira hacia la derecha? ¿Esa parte del campo es más naranja que otros sectores? Buscamos esos pequeños patrones en los videos y le enseñamos al algoritmo a detectar ‘deepfakes”, explicó el responsable de Cyabra.

El enfoque de la compañía es más sofisticado que los métodos tradicionales para descubrir estas dañinas piezas. Así, los expertos analizan metadatos de dónde se tomó una foto, qué tipo de cámara se usó y en qué fecha se produjo.

«Puede que nuestro algoritmo no sepa el nombre exacto de quién hizo la manipulación pero sí sabrá que el video no es real”, aseguró Brahmy, que describió que con apenas un programa de computadora se puede detectar signos reveladores que el ojo humano no ve como lentes que no se ajustan bien a un rostro o movimientos de labios que no se sincronizan con los movimientos del mentón y la nuez de Adán.

Cyabra, unos pasos adelante que el resto

La tecnología de detección de Deepfake evoluciona de forma continua. En 2017, cuando comenzaron a aparecer los “deepfakes”, los ojos falsos no parpadeaban con normalidad pero en cuanto los investigadores alertaron a la gente para que observara los movimientos anormales de los ojos, el parpadeo de los videos falsos mejoró de forma notable hasta volverse casi imperceptible.

«Para ser una verdadera y duradera solución, hay que adelantarse uno o dos años. Sólo de esta forma te aseguras de que nadie pueda volver a hacer lo que acabas de terminar», confió el directivo.

La ventaja de Cyabra por sobre otras empresas es que dos de sus cuatro cofundadores trabajaron en las divisiones de inteligencia de las Fuerzas de Defensa de Israel. Allí buscaron vías de frustrar a los grupos terroristas que intentaban crear perfiles falsos para conectarse con israelíes.

Además, el ex subdirector del Mossad, Ram Ben Barak, forma parte de la junta directiva de la compañía.

Perfiles falsos en redes sociales

La tecnología de detección de “deepfakes” de Cyabra fue lanzada hace unos meses. Durante la mayor parte de los últimos dos años, desde que se fundó, la empresa se centró en detectar perfiles falsos en las redes sociales.

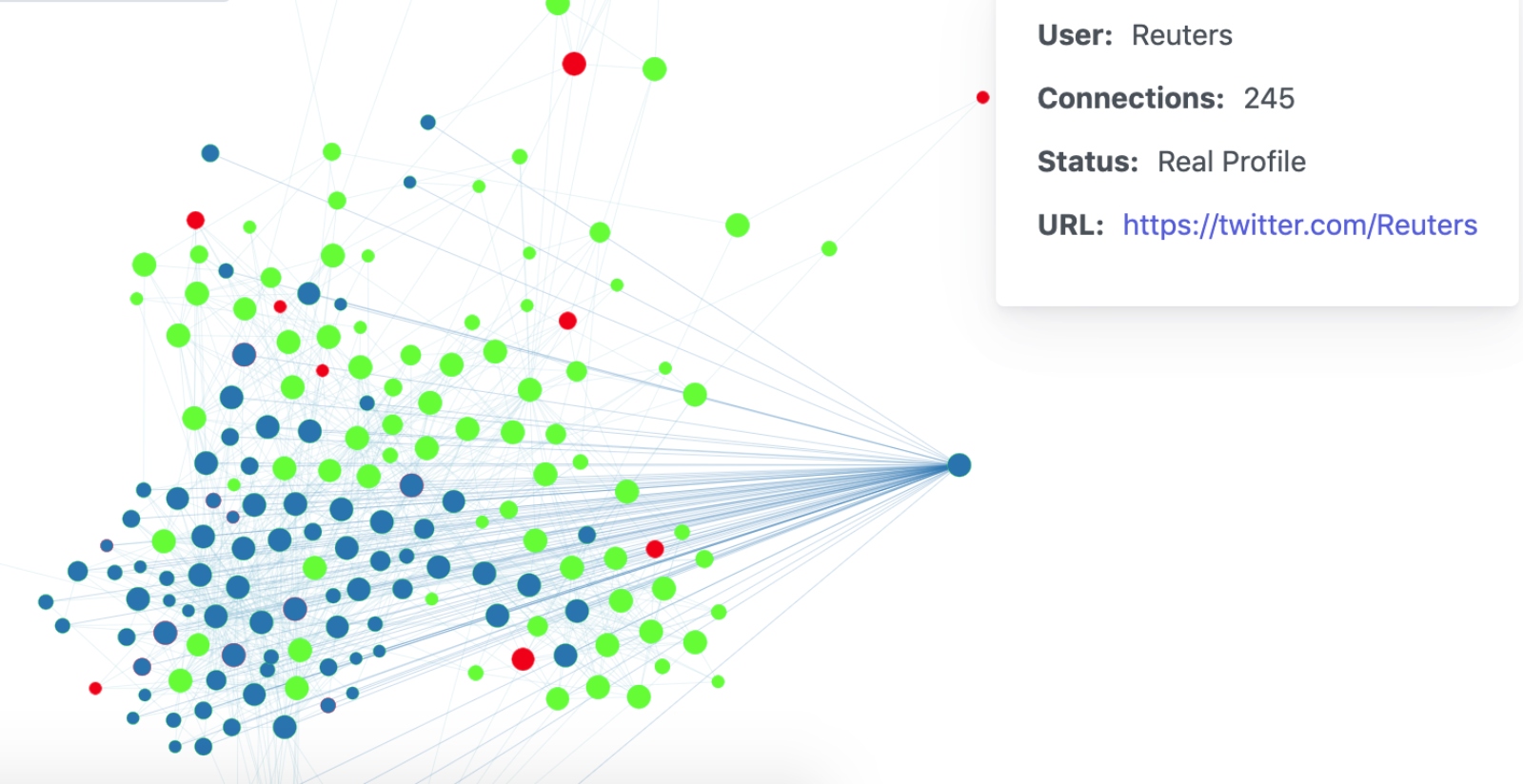

Yossef Daar, director de operaciones y cofundador de Cyabra, manifestó que hay 140 millones de cuentas falsas en Facebook, 38 millones en LinkedIn y 48 millones de “bots” en Twitter. Y que estos perfiles tampoco son fáciles de detectar.

Un dato: investigadores de la Universidad de Iowa descubrieron que unos 100 millones de «Me gusta» que aparecieron en Facebook entre 2015 y 2016 fueron creados por personas que usaron cerca de un millón de perfiles falsos.

Los algoritmos de aprendizaje automático de Cyabra usan unos 300 parámetros únicos para determinar la autenticidad de una cuenta. Un perfil de tres días con 700 amigos cuyo usuario no “existe” fuera de Facebook es un signo de alerta.

En las elecciones de 2016 en EEUU, los perfiles falsos en las redes sociales fueron el mayor problema porque los “deepfakes” todavía no existían. Pero en estos días es muy probable que la mayoría de la gente que usa Internet se haya cruzado con una falsificación.

Algunos ejemplos de famosos “deepfakes: el director general de Facebook Mark Zuckerberg se jacta de tener el «control total de los datos robados de miles de millones de personas«, el ex presidente norteamericano Barack Obama usa una blasfemia para describir al mandatario Donald Trump y Jon Snow se disculpa por la temporada 8 de Juego de tronos.

Según Brahmy, el período previo a las elecciones 2020 en EEUU es el momento ideal para ofrecer la solución de Cyabra. Los inversores están de acuerdo y Cyabra ya reunió tres millones de dólares de TAU Ventures y un millón más de la Autoridad de Innovación de Israel.

La compañía, que hoy cuenta con un personal de 15 empleados, comenzó sus días en The Bridge, una aceleradora de siete meses con sede en Tel Aviv patrocinada por Coca-Cola, Turner y Mercedes.

Ahora, Cyabra sigue en una etapa de crecimiento gracias a TAU Ventures y ya tiene una pequeña presencia también en EEUU.

Clientes de los sectores público y privado

Los clientes de Cyabra prefieren no ser identificados. Brahmy le contó a ISRAEL21c que el 50 por ciento de estos están en el sector público, organizaciones o agencias gubernamentales y la otra mitad se encuentra en el “mundo de las marcas sensibles”: bienes de consumo, alimentos, bebidas y multimedios.

«Si estás en el negocio de dar información imparcial y de repente 500 ‘bots’ te envían un mensaje con una imagen falsificada, podrías encontrarte en la situación de estar listo para publicarla. Nosotros queremos estar allí cinco segundos antes de que lo hagas para hacerte saber que la foto es falsa”, afirmó Brahmy.

Cyabra deja la tarea de verificar el contenido de «noticias falsas» a otras compañías como NewsGuard y FactMata. Y aunque también hay otras empresas que se ocupan de “deepfakes” y perfiles falsos, Brahmy describió que la suya es la única que hace ambas tareas “con la capacidad técnica de detectar ‘deepfakes’ junto con análisis de canales cruzados para detectar los bots que activan perfiles falsos en las redes sociales”.

En enero de 2020 Facebook anunció que está prohibiendo las falsificaciones profundas destinadas a engañar en lugar de entretener. Pero, ¿Facebook puede realmente adelantarse a todas las falsificaciones que hay y las que vendrán?

Si Cyabra y su competencia tienen éxito, la próxima vez que vea a un político o una celebridad “diga” algo que parece censurable, esto podría ser cierto.

Para más información, clic aquí.

Debes estar conectado para publicar un comentario. Oprime aqui para conectarte.

¿Aún no te has registrado? Regístrate ahora para poder comentar.